Apenas unas horas después de la atrocidad de Bondi Beach, la desinformación inundó las redes sociales, con afirmaciones de un héroe falso y un actor pagado e innumerables clips que difundían narrativas falsas.

El tiroteo contra el padre y su hijo Sajid y Naveed Akram, que dejó 15 muertos durante una celebración de Hanukkah el domingo, ha generado más preocupación por las imágenes de IA y las noticias falsas.

El servicio FactCheck de Australian Associated Press encontró al menos una docena de ejemplos de falsedades y teorías de conspiración difundidas en línea.

Estos incluyen informes falsos de que un profesional de TI de 43 años llamado Edward Crabtree era el hombre (luego identificado correctamente como Ahmed Al Ahmed) que fue captado en video arrebatándole un arma de la mano a uno de los terroristas de Bondi.

Un informe de noticias falso identificó incorrectamente a Ahmed Al Ahmed como “Edward Crabtree local de Bondi”. (FOLLETO/The Daily Aus)

La afirmación se hizo en un artículo publicado en un sitio web de noticias falsas llamado The Daily bajo el nombre de una supuesta reportera llamada Rebecca Chen.

Ni Crabtree ni el periodista son reales, mientras que una búsqueda en la información del dominio del sitio web muestra que fue registrado en una dirección en Islandia el día del ataque, el 14 de diciembre.

También circularon vídeos manipulados, incluido un clip en el que el primer ministro Anthony Albanese supuestamente anunció que todas las visas de los ciudadanos paquistaníes serían canceladas tras el ataque terrorista.

Otra película muestra imágenes falsas del primer ministro de Nueva Gales del Sur, Chris Minns, que revelan detalles no confirmados en ese momento de que uno de los tiradores era un ciudadano indio.

La IA se ha utilizado para difundir información falsa sobre comentarios hechos por líderes políticos. (FOLLETO/X)

Los investigadores de FactCheck de la AAP confirmaron que ambos videos eran falsos.

También hubo afirmaciones falsas de que uno de los tiradores había servido anteriormente en las Fuerzas de Defensa de Israel.

Pero la información errónea se ha extendido más allá de las publicaciones en línea y varias imágenes generadas por IA se han vuelto virales.

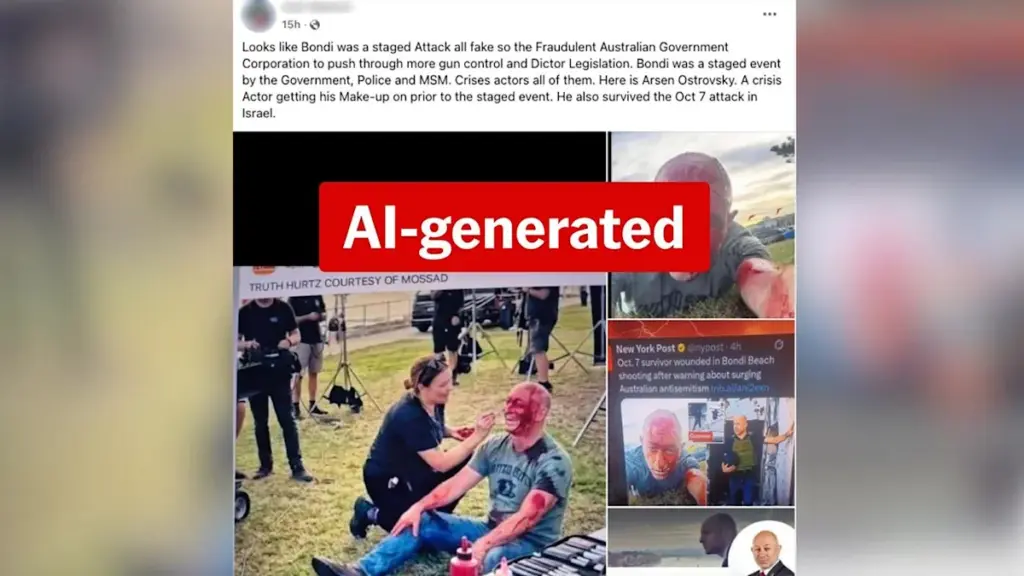

Está circulando una imagen fija que afirma falsamente que Arsen Ostrovsky, que fue entrevistado por periodistas de televisión después del ataque, vendado y cubierto de sangre, era un “actor de crisis” a sueldo.

Se dice que la fotografía simulada que ha circulado ampliamente muestra al Sr. Ostrovsky aplicándose maquillaje mientras está rodeado por un equipo de filmación, lo que sugiere que la masacre, que se desató desde el puente peatonal de Campbell Parade, fue un montaje.

Ostrovsky ha sido atacado por segunda vez por afirmaciones de que una fotografía manipulada mostraba que sus heridas eran falsas.

En otros lugares, han surgido imágenes manipuladas que pretenden mostrar a Naveed Akram reuniéndose con el agregado de defensa de la India en Filipinas, el capitán Chandra Kant Kothari.

La experta en inteligencia artificial de Swinburne, Atie Kia, dijo que las plataformas de redes sociales combinadas con herramientas de inteligencia artificial cada vez más accesibles están permitiendo la rápida difusión de deepfakes y narrativas falsas.

“Después de una tragedia, la gente busca respuestas y eso crea el espacio perfecto para que se difundan imágenes generadas por IA e historias falsas”, dijo a la AAP.

Esta imagen de IA pretende mostrar a Naveed Akram reuniéndose con el agregado de defensa de la India en Filipinas. (FORMATO/FACEBOOK)

El Dr. Kia dijo que se trataba de la rapidez con la que la información errónea podría influir en la percepción pública durante una crisis, y añadió que el contenido generado por IA se estaba volviendo más sofisticado y difícil de detectar.

Ella cree que las prácticas de verificación estrictas y la mejora de la alfabetización digital podrían ayudar a contener la propagación.

“La gente piensa que se necesita un profesional para crear vídeos falsos, pero sólo se necesitan unos pocos clics”, añadió el Dr. Kia.

“Es fácil incorporar el rostro de una persona real a una imagen violenta, e incluso si resulta ser falsa, el daño a la reputación puede ser duradero”.

“Nunca ha sido más importante que las personas hagan su propia investigación antes de compartir publicaciones virales”, añadió el Dr. Kia.

Los informes falsos, la manipulación de la IA y la desinformación aumentan el dolor de una comunidad en duelo. (Mick Tsikas/FOTOS AAP)

Incluso una semana después del ataque mortal, la difusión de contenido falso continuó.

Esto incluye acalorados debates en línea sobre la nacionalidad de los pistoleros, aunque las autoridades ya han publicado detalles.

El gobierno australiano ha confirmado que uno de los pistoleros nació en Australia y la policía india dijo que el otro era originario de Hyderabad.

Línea de vida 13 11 14

más allá del azul 1300 22 4636