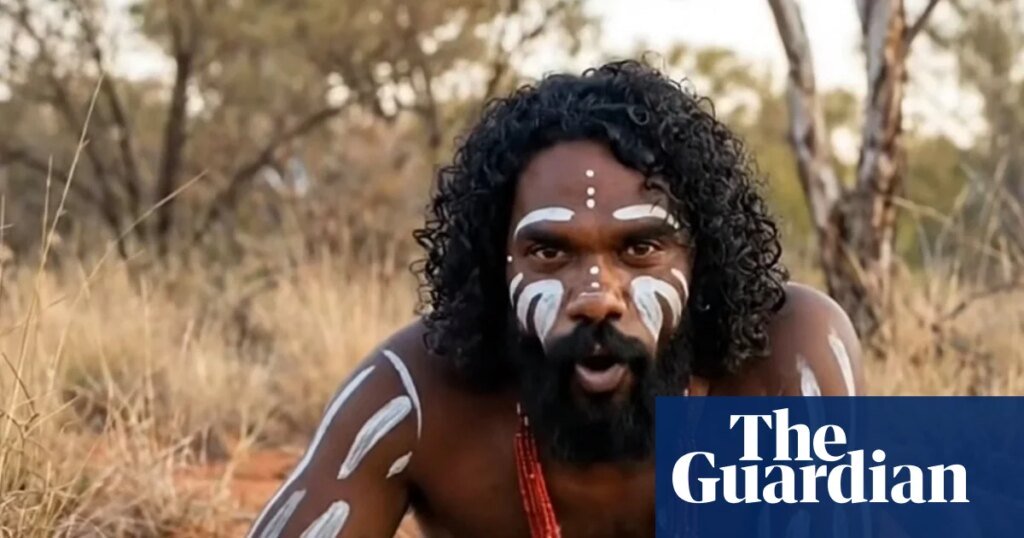

Con una mata de rizos oscuros y ojos marrones, Jarren se encuentra en medio del interior de Australia, con tierra roja a sus pies y una serpiente desplegándose ante él.

En una serie de vídeos online, la estrella de las redes sociales, conocida online como “Bush Legend”, camina por densos bosques o conduce por carreteras desiertas en busca de águilas de cola de cuña. Muchos de los vídeos van acompañados de instrumentos de percusión pulsantes y yidakis (didgeridoo).

Su voz suena como una mezcla de Costa Georgiadis de Gardening Australia y Steve Irwin. Su discurso está salpicado de “mate” y “crikey” mientras comparte apasionadamente fragmentos de la vida silvestre australiana con miles de sus seguidores, desde serpientes venenosas y cocodrilos hasta arañas de lomo rojo y los esquivos loros nocturnos, que alguna vez se pensaron extintos.

Sus seguidores dejan comentarios de admiración, se maravillan de cómo puede acercarse tanto a los animales e incluso sugieren que necesita su propio programa de televisión.

Pero nada de eso es real. La vida salvaje y el hombre que la presenta son creaciones de la IA.

Meta afirma que la cuenta, creada en octubre de 2025, tiene su sede en Nueva Zelanda, y la cuenta de Instagram originalmente compartía una cuenta de noticias satíricas generada por IA llamada “Nek Minute News” antes de centrarse en contenido sobre vida silvestre. Encarnaciones anteriores de Bush Legend representan al personaje con pintura corporal blanca que parece imitar el ocre y un collar de perlas adornando su cuello.

A partir de esta semana, la cuenta de Bush Legend tiene 90.000 seguidores en Instagram y 96.000 en Facebook. La atención se centra en crear conciencia y educación sobre la vida silvestre australiana.

Guardian Australia se ha puesto en contacto con la persona que se cree que creó la cuenta, que es un sudafricano que vive en Nueva Zelanda. No respondieron a múltiples solicitudes.

“Aplanamiento cultural”

La decisión de crear un avatar de un indígena ha generado preocupaciones éticas.

La Dra. Terri Janke, abogada y experta en propiedad intelectual y cultural indígena, dice que las imágenes y el contenido son “notables” por su realismo.

“Crees que es real, simplemente estaba hojeando y pensé: '¿Cómo es que nunca he oído hablar de este tipo?' Es mortal, debería tener su propio programa”, dice. “¿Es el Steve Irwin negro? Con sus pantalones verdes o caqui es un poco como Steve Irwin y David Attenborough.

Pero si bien la mujer Wuthathi, Yadhaigana y Meriam dice que los atractivos videos son “bastante increíbles si los miras como una herramienta educativa”, crear un avatar aparentemente indígena es ofensivo y corre el riesgo de un “aplanamiento cultural”.

“¿La imagen personal de quién usaron para crear a esta persona? ¿Unieron a la gente?” ella pregunta. “Me siento un poco engañado por todo esto”.

El contenido generado por IA plantea un riesgo particular para las comunidades marginadas y podría verse como un robo de propiedad cultural e intelectual. También potencialmente elimina oportunidades para realizar informes auténticos, como videos producidos por la vasta red de guardabosques aborígenes.

“Se trata de un robo, que es muy insidioso porque también causa daños culturales”, afirma Janke. “Debido a la discriminación… los efectos de los estereotipos y el pensamiento negativo, esos efectos en realidad afectan más fuerte”.

Janke dice que es posible utilizar éticamente la tecnología de inteligencia artificial para crear contenido sobre las personas de las Primeras Naciones, pero esto requiere el consentimiento y la participación de las personas de las Primeras Naciones.

Tamika Worrell, profesora de estudios indígenas críticos en la Universidad Macquarie, dice que el avatar de IA es una forma de apropiación cultural y “cara negra digital”, en la que una persona no negra crea en línea una caricatura negra o indígena.

Los Kamilaroi Mujer dice que la proliferación de herramientas de inteligencia artificial sin la protección legal adecuada significa que las imágenes, el conocimiento cultural y las historias pueden transferirse sin el consentimiento apropiado.

“La IA se está convirtiendo en esta nueva plataforma sobre la que no tenemos control ni voz”, afirma.

“No solo se pueden tomar historias o lenguaje, sino también imágenes reales de nosotros mismos de personas fallecidas, o simplemente de un grupo de personas diferentes juntas (para crear un avatar de IA) sin ninguna responsabilidad hacia las comunidades de las que provienen estas personas.

“Es la cara negra de la IA: la gente puede simplemente crear arte, crear personas, (pero) en realidad no se relacionan con los pueblos indígenas”.

El potencial de daño es doble: tales relatos comparten por defecto los aspectos “agradables” o “cómodos” del conocimiento y la experiencia cultural indígena en lugar de la realidad más compleja; y también tiene el potencial de aumentar el racismo.

“Miré los comentarios de una publicación reciente de Bush Legend. Vemos los mismos comentarios racistas que sabemos que recibe la mafia en línea. También los vemos aplicados a una persona con inteligencia artificial”, dice.

Toby Walsh, ganador del premio y profesor de ciencias de inteligencia artificial en la Universidad de Nueva Gales del Sur, dice que la IA está entrenada para reproducir información y representación a través de grandes conjuntos de datos con sesgos incorporados, lo que significa que no es inmune al contenido racista o prejuicioso.

“Cargarán los sesgos de esos datos de entrenamiento”, dice. “Ciertos grupos pueden ser estereotipados porque los datos de video o imágenes que existen en línea en ese grupo están estereotipados de alguna manera. Por lo tanto, perpetuaremos este estereotipo en el futuro”.

Guardian Australia intentó contactar al creador de la página a través de múltiples cuentas de redes sociales y correo electrónico, pero aún no ha recibido una respuesta.

La cuenta de Bush Legend parece haber abordado las críticas a través de su avatar, diciendo que la página no intenta “representar ninguna cultura o grupo”. “Este canal trata solo de historias de animales”, dijo la creación de AI en un video la semana pasada.

Continúa diciendo que el sitio “no solicita dinero, donaciones ni apoyo” y que el contenido es “de visualización gratuita”. También anima a las personas a “desplazarse más” si no les gusta. Los anuncios anteriores pedían a sus seguidores que se registraran por 2,99 dólares al mes.

Se ha contactado a Meta para obtener más comentarios.

Walsh dice que si bien la alfabetización digital puede ayudar a los usuarios a identificar el contenido de la IA, los “indicadores” que ayudan con la identificación son cada vez más difíciles de detectar. “Si no es ahora, en un futuro próximo será casi imposible saber siquiera si esto fue real o falso”, dice Walsh.

“Solíamos creer en las cosas que veíamos, porque antes, las cosas que veías eran en su mayoría cosas reales.

“Ahora no es difícil falsificar cosas. Es increíblemente fácil falsificar cosas de maneras muy convincentes, así que vamos a traspasar los límites entre lo verdadero y lo falso”.